Esta página não é uma página oficial do aplicativo ou de seu desenvolvedor, mas uma publicação editorial independente criada para fins informativos e de comentário. Salvo indicação expressa em contrário, nem o aplicativo nem seu desenvolvedor são afiliados, endossados, patrocinados, autorizados ou oficialmente conectados à MWM, Apple, Google Play, ao editor do aplicativo ou ao desenvolvedor do aplicativo, e nada nesta página implica que o aplicativo foi desenvolvido utilizando os serviços da MWM. Todas as marcas comerciais, logotipos, capturas de tela e outros conteúdos permanecem propriedade de seus respectivos proprietários.

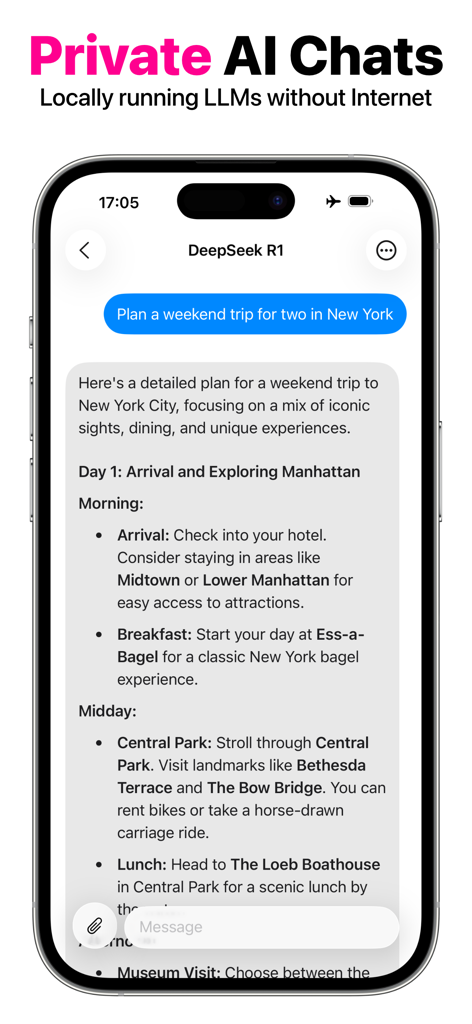

OfflineLLM: Private AI Chat

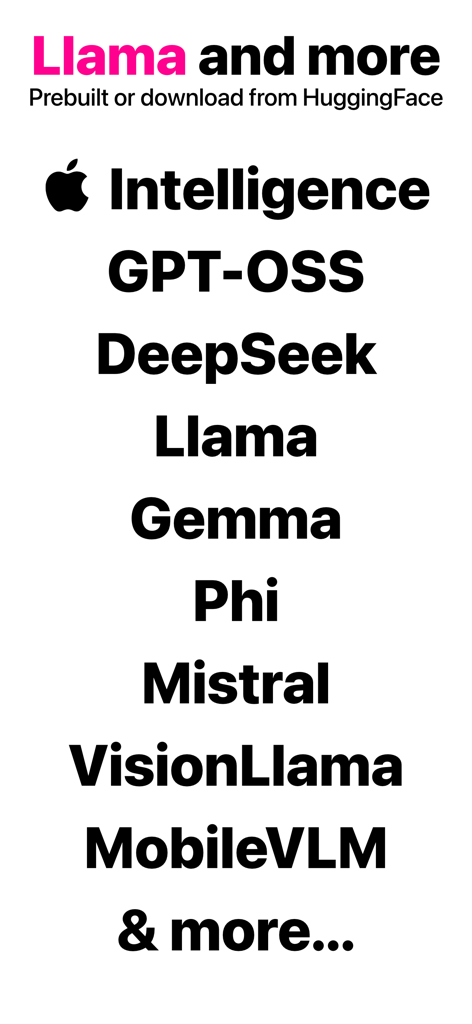

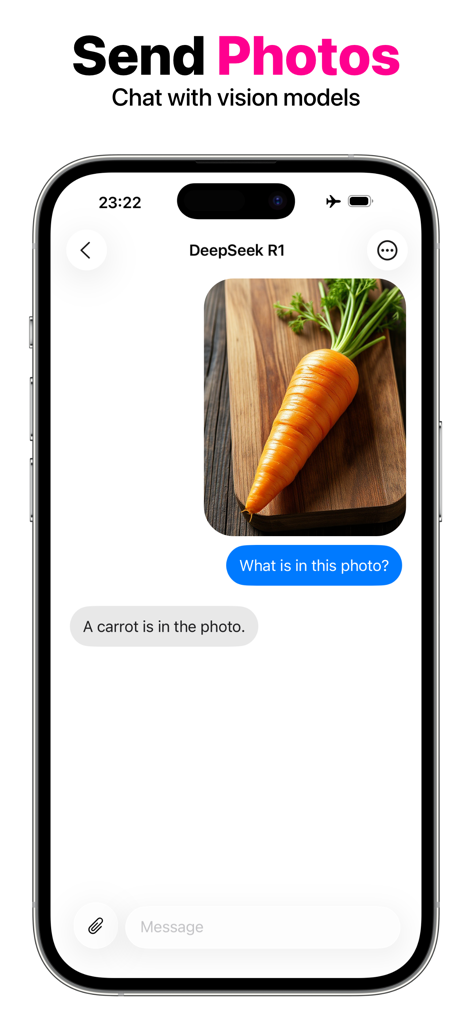

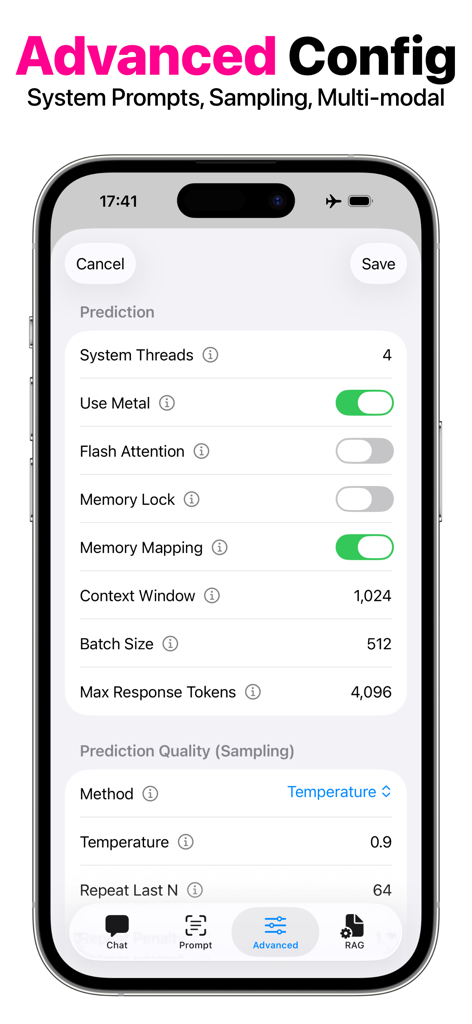

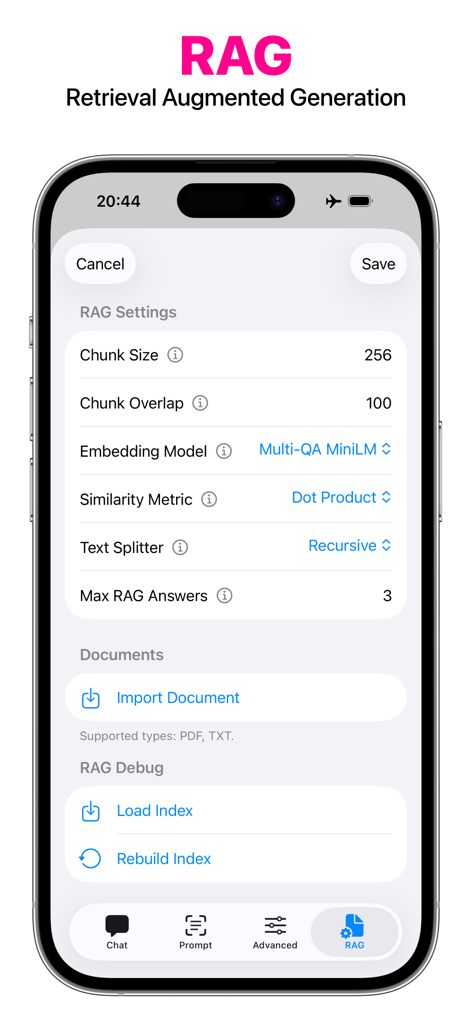

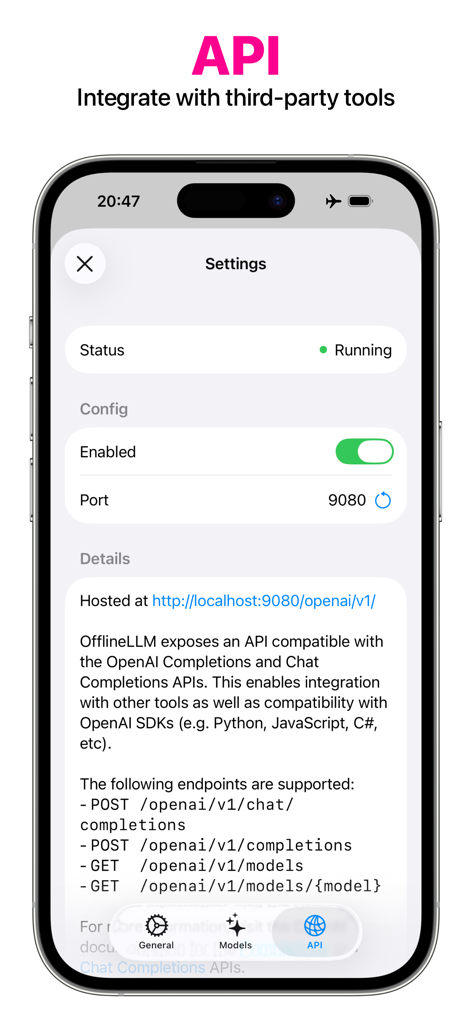

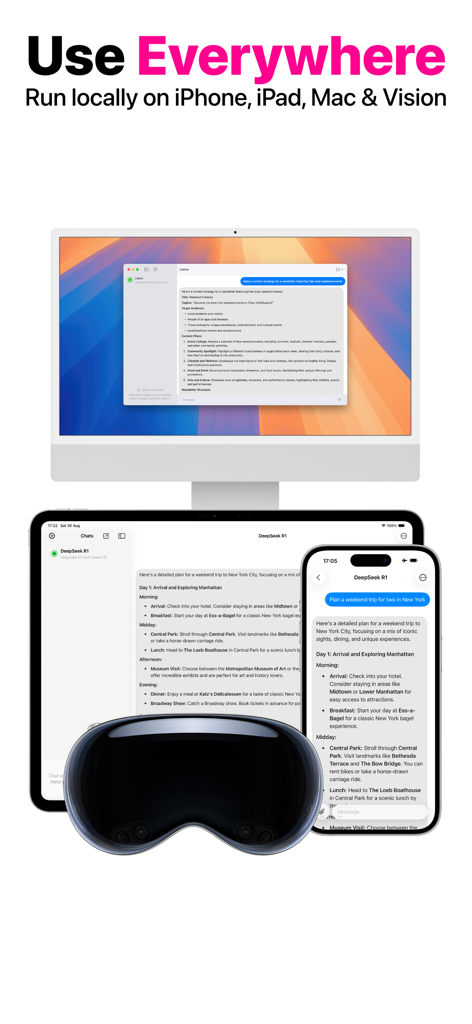

Proteja a soberania dos seus dados com o motor de IA offline mais rápido. Utilize Llama, DeepSeek e Mistral localmente no seu iPhone, Mac e Vision Pro com desempenho Metal 3, suporte RAG e zero dependência da nuvem.

Downloads

5K+Avaliação

Total de avaliações

0Editor

Categoria

ProductivityIdiomas

2Última versão

4.0.2Tamanho

526.8 MBData de lançamento

19 de dez. de 2023Privacidade Incompromissível, Desempenho de Nível Desktop

Utilize o poder dos LLMs locais em seus dispositivos Apple. Sem internet, sem rastreamento e sem vazamento de dados — apenas inteligência pura e privada otimizada para Apple Silicon.

Soberania de Dados Zero-Nuvem

Tudo fica no dispositivo. Processe petições legais confidenciais, código proprietário ou registros pessoais com a certeza absoluta de que seus dados nunca serão usados para treinamento ou armazenados em um servidor remoto.

Otimização Nativa Metal 3

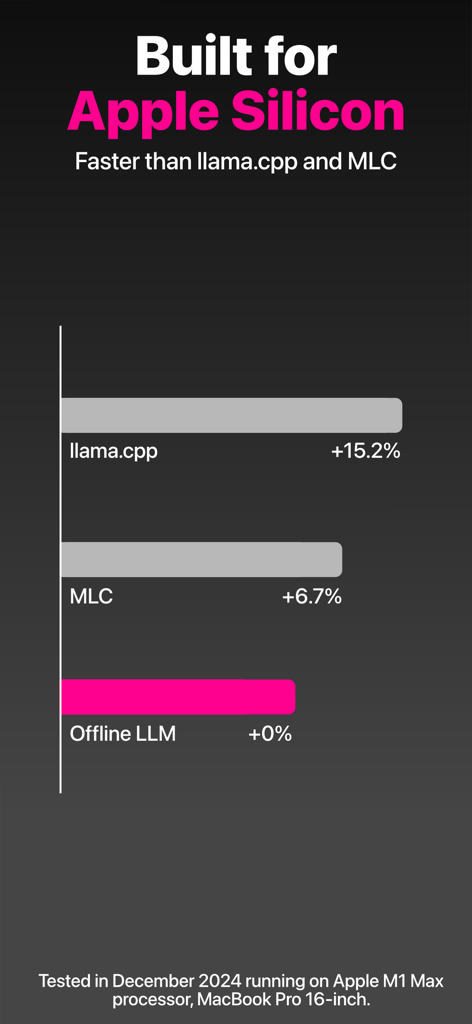

Engenheirado para o máximo de throughput em chips da série M. Supera implementações padrão ao alavancar um motor de execução personalizado projetado para respostas fluidas e em tempo real no iPhone, iPad e Mac.

Apps Semelhantes

Apps mais bem classificados na mesma categoria

ChatGPT

OpenAI OpCo, LLC

Google Gemini

Google LLC

Grok

X.AI Corporation

Gmail - Email by Google

Google LLC

千问 - 阿里最强大模型官方AI助手

Shanghai Zhixin Puhui Technology Co., Ltd.

Google Drive

Google LLC

Microsoft Authenticator

Microsoft Corporation

Google Sheets

Google LLC

Google Docs

Google LLC

Esta página não é uma página oficial do aplicativo ou de seu desenvolvedor, mas uma publicação editorial independente criada para fins informativos e de comentário. Salvo indicação expressa em contrário, nem o aplicativo nem seu desenvolvedor são afiliados, endossados, patrocinados, autorizados ou oficialmente conectados à MWM, Apple, Google Play, ao editor do aplicativo ou ao desenvolvedor do aplicativo, e nada nesta página implica que o aplicativo foi desenvolvido utilizando os serviços da MWM. Todas as marcas comerciais, logotipos, capturas de tela e outros conteúdos permanecem propriedade de seus respectivos proprietários.