Questa pagina non è una pagina ufficiale dell'app o del suo sviluppatore, ma una pubblicazione editoriale indipendente creata a scopo informativo e di commento. Salvo espressa indicazione contraria, né l'app né il suo sviluppatore sono affiliati, approvati, sponsorizzati, autorizzati o altrimenti ufficialmente collegati a MWM, Apple, Google Play, all'editore dell'app o allo sviluppatore dell'app, e nulla in questa pagina implica che l'app sia stata sviluppata utilizzando i servizi di MWM. Tutti i marchi, loghi, screenshot e altri contenuti rimangono di proprietà dei rispettivi proprietari.

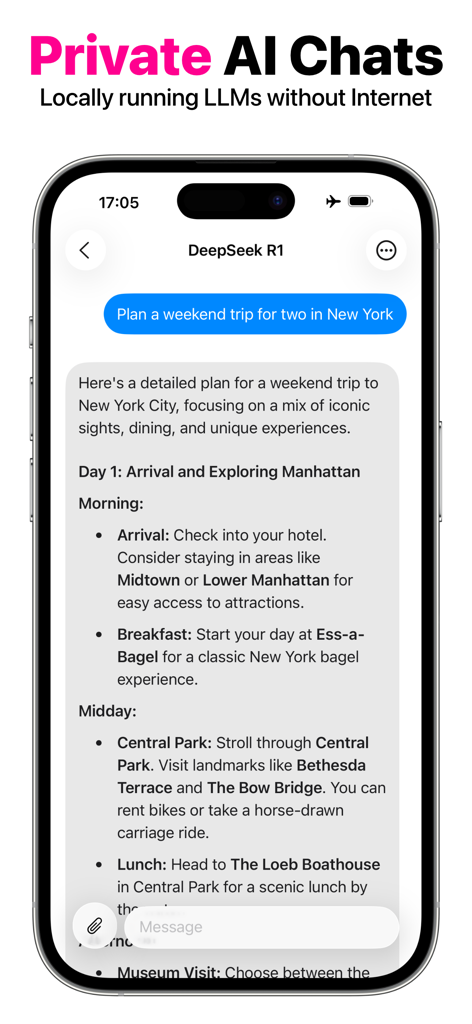

OfflineLLM: Private AI Chat

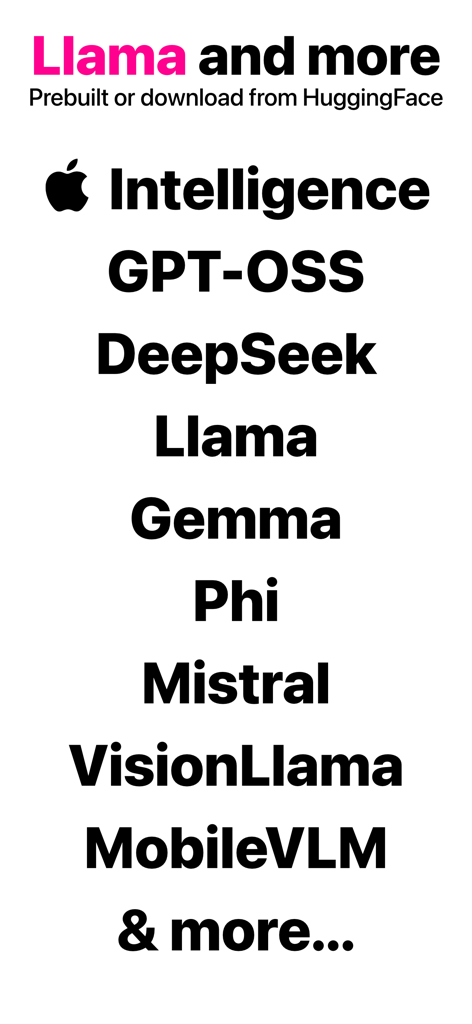

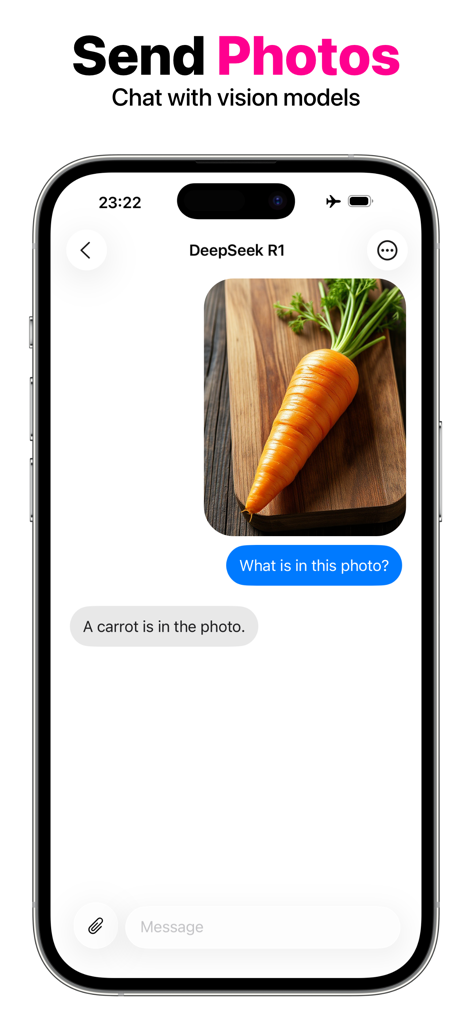

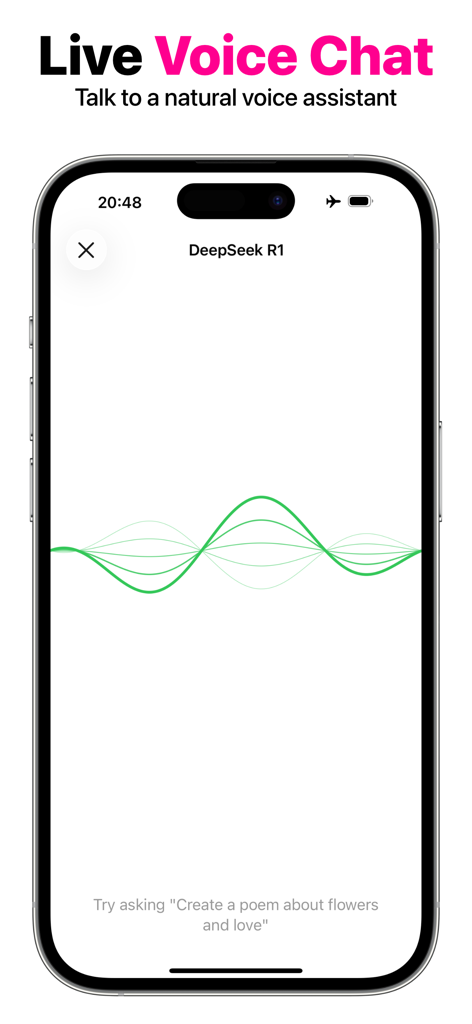

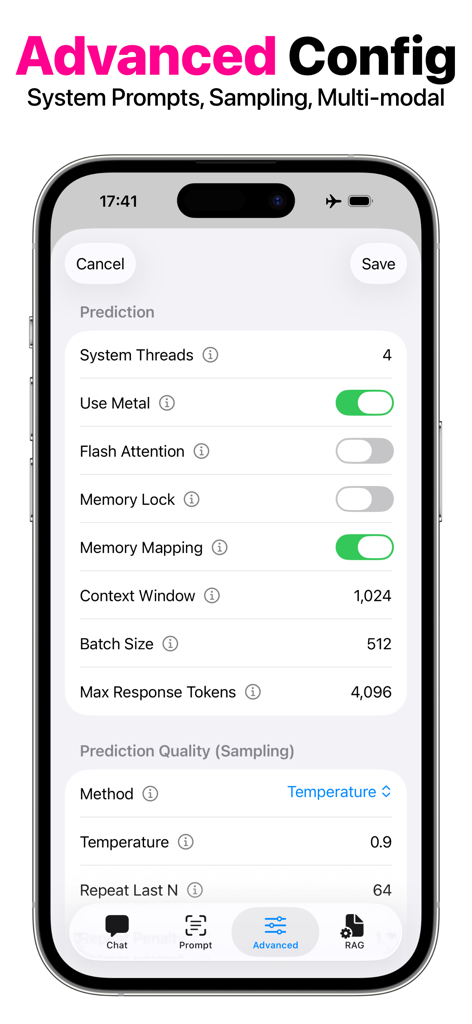

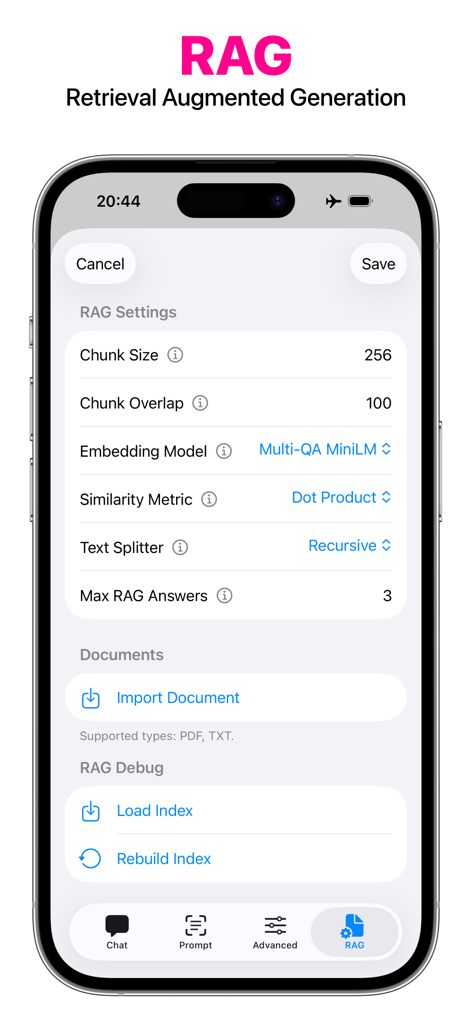

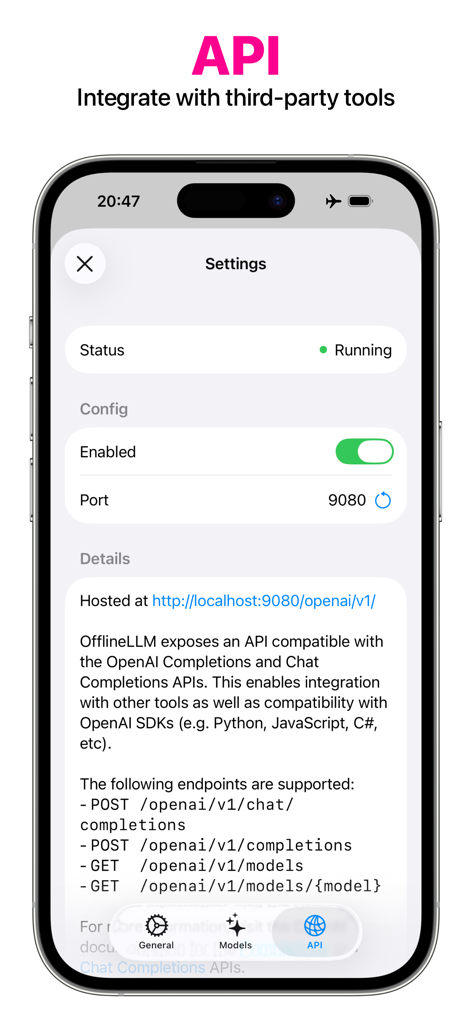

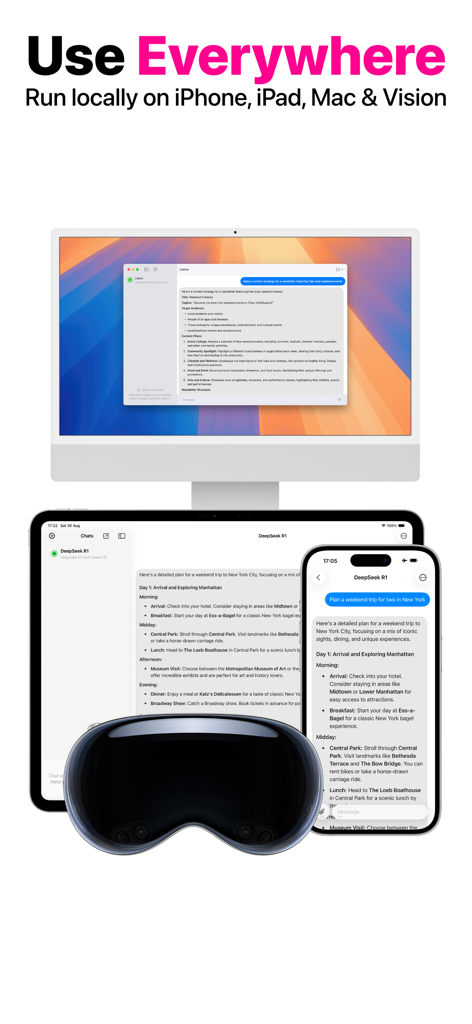

Proteggi la sovranità dei tuoi dati con il motore AI offline più veloce. Sfrutta Llama, DeepSeek e Mistral localmente sul tuo iPhone, Mac e Vision Pro con prestazioni Metal 3, supporto RAG e zero dipendenza dal cloud.

Download

5K+Valutazione

Valutazioni totali

0Editore

Categoria

ProductivityLingue

2Ultima versione

4.0.2Dimensione

526.8 MBData di lancio

19 dic 2023Privacy Senza Compromessi, Prestazioni di Classe Desktop

Sfrutta la potenza degli LLM locali sui tuoi dispositivi Apple. Nessun internet, nessun tracciamento e nessuna fuga di dati — solo intelligenza pura e privata ottimizzata per Apple Silicon.

Sovranità dei Dati Zero-Cloud

Tutto rimane sul dispositivo. Elabora documenti legali riservati, codice proprietario o registri personali con la certezza assoluta che i tuoi dati non vengano mai utilizzati per l'addestramento o memorizzati su un server remoto.

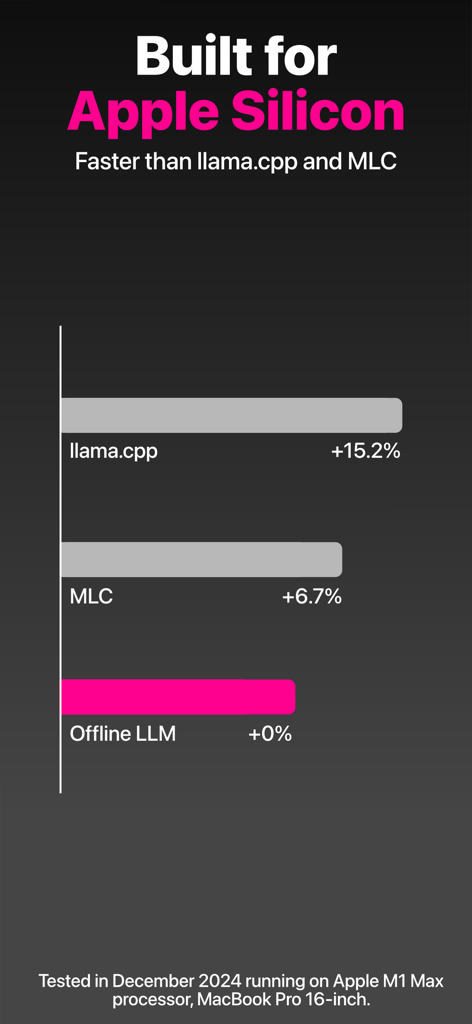

Ottimizzazione Nativa Metal 3

Progettato per la massima velocità di elaborazione sui chip della serie M. Supera le implementazioni standard sfruttando un motore di esecuzione personalizzato progettato per risposte fluide e in tempo reale su iPhone, iPad e Mac.

App Simili

App più classificate nella stessa categoria

ChatGPT

OpenAI OpCo, LLC

Google Gemini

Google LLC

Grok

X.AI Corporation

Gmail - Email by Google

Google LLC

千问 - 阿里最强大模型官方AI助手

Shanghai Zhixin Puhui Technology Co., Ltd.

Google Drive

Google LLC

Microsoft Authenticator

Microsoft Corporation

Google Sheets

Google LLC

Google Docs

Google LLC

Questa pagina non è una pagina ufficiale dell'app o del suo sviluppatore, ma una pubblicazione editoriale indipendente creata a scopo informativo e di commento. Salvo espressa indicazione contraria, né l'app né il suo sviluppatore sono affiliati, approvati, sponsorizzati, autorizzati o altrimenti ufficialmente collegati a MWM, Apple, Google Play, all'editore dell'app o allo sviluppatore dell'app, e nulla in questa pagina implica che l'app sia stata sviluppata utilizzando i servizi di MWM. Tutti i marchi, loghi, screenshot e altri contenuti rimangono di proprietà dei rispettivi proprietari.