Diese Seite ist keine offizielle Seite der App oder ihres Entwicklers, sondern eine unabhängige redaktionelle Veröffentlichung, die zu Informations- und Kommentarzwecken erstellt wurde. Sofern nicht ausdrücklich anders angegeben, sind weder die App noch ihr Entwickler mit MWM, Apple, Google Play, dem App-Herausgeber oder dem Entwickler der App verbunden, von ihnen unterstützt, gesponsert, autorisiert oder anderweitig offiziell verbunden, und nichts auf dieser Seite impliziert, dass die App unter Verwendung der Dienste von MWM entwickelt wurde. Alle Marken, Logos, Screenshots und andere Inhalte bleiben Eigentum ihrer jeweiligen Inhaber.

OfflineLLM: Private AI Chat

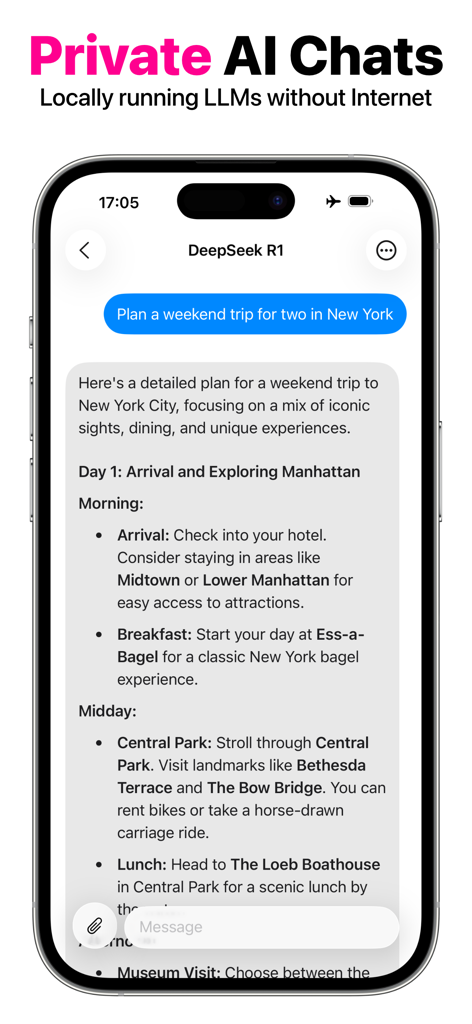

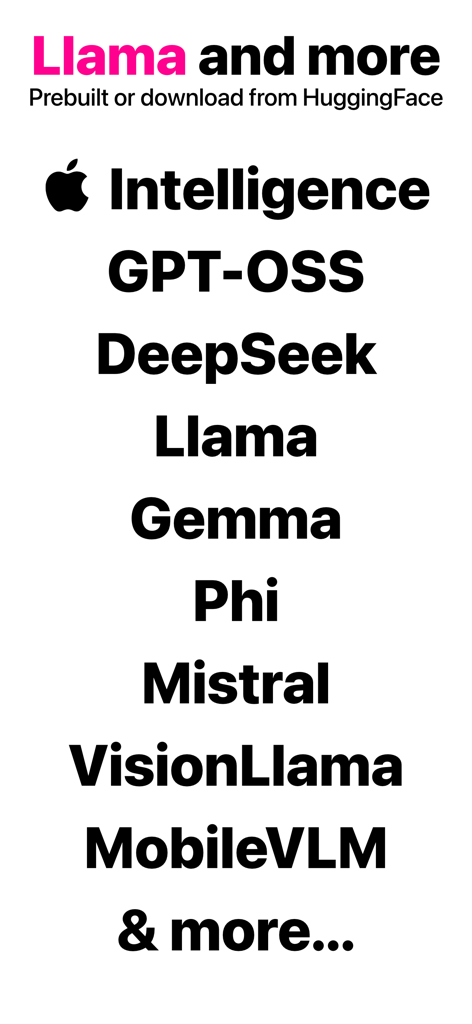

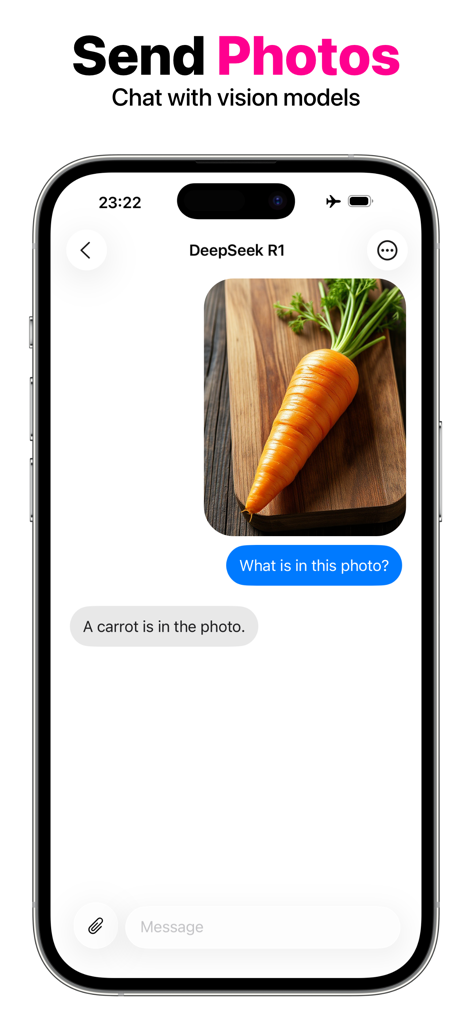

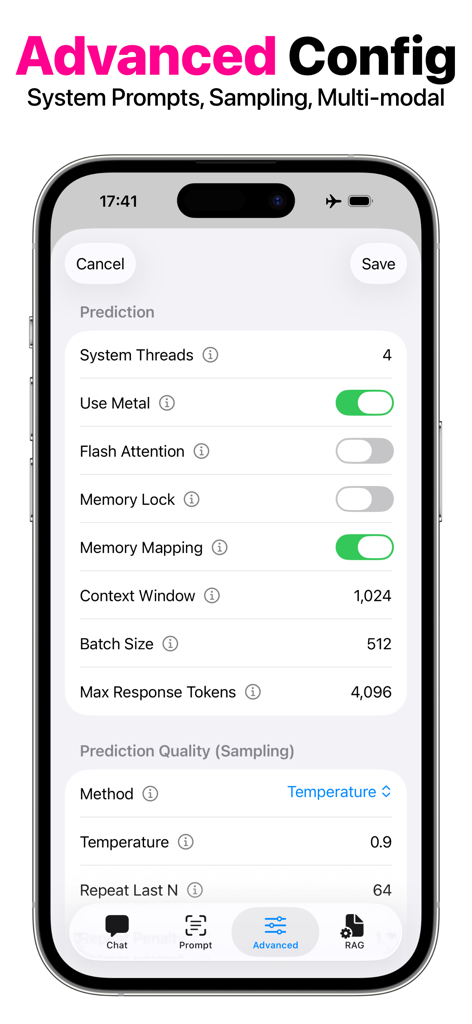

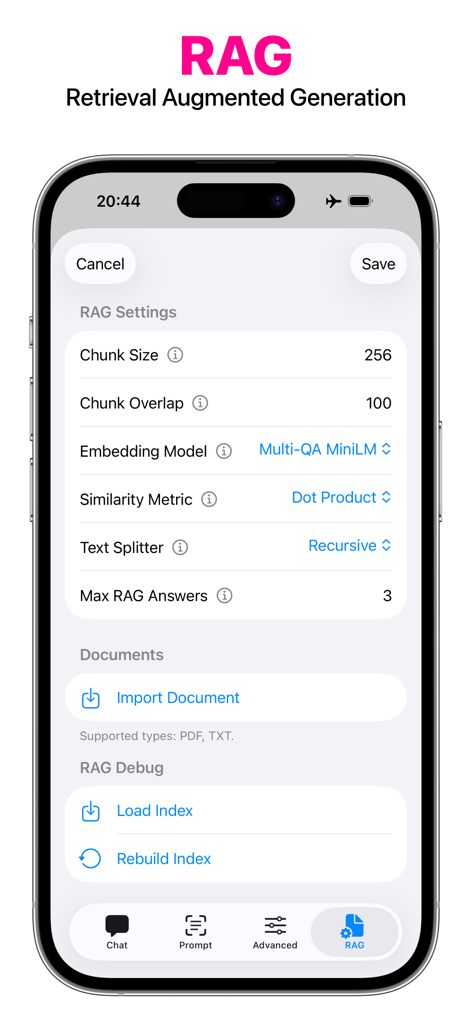

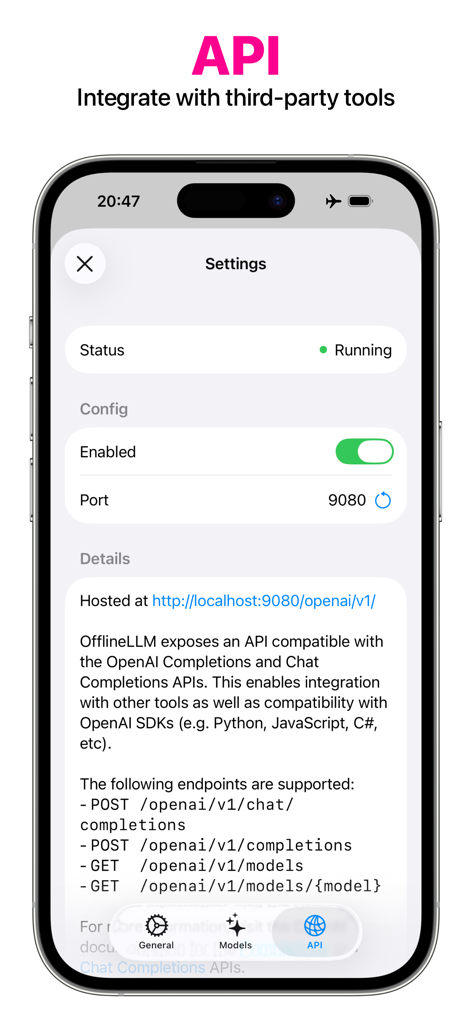

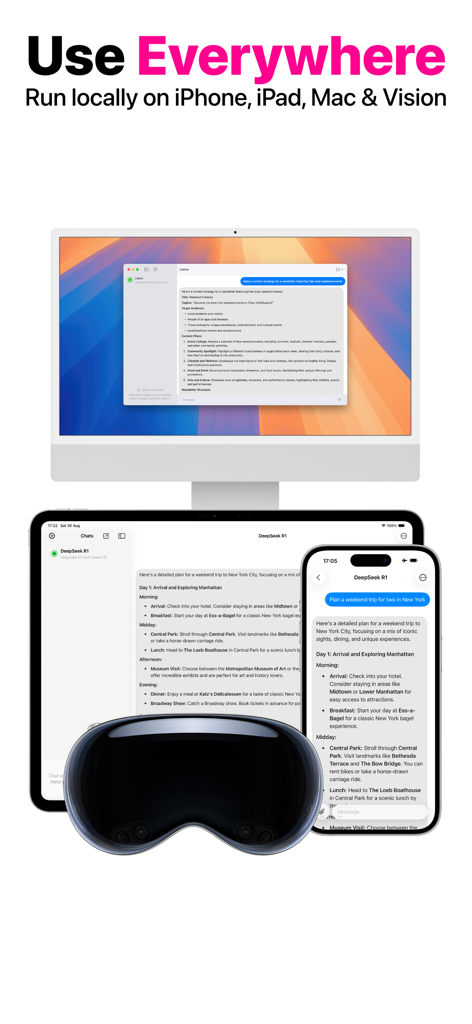

Sichern Sie Ihre Datensouveränität mit der schnellsten Offline-KI-Engine. Nutzen Sie Llama, DeepSeek und Mistral lokal auf Ihrem iPhone, Mac und Vision Pro mit Metal 3-Leistung, RAG-Unterstützung und keinerlei Cloud-Abhängigkeit.

Downloads

5K+Bewertung

Bewertungen gesamt

0Herausgeber

Kategorie

ProductivitySprachen

2Neueste Version

4.0.2Größe

526.8 MBErstveröffentlichung

19. Dez. 2023Kompromisslose Privatsphäre, Desktop-Klasse Leistung

Nutzen Sie die Leistung lokaler LLMs auf Ihren Apple-Geräten. Kein Internet, keine Nachverfolgung und keine Datenlecks – nur reine, private Intelligenz, optimiert für Apple Silicon.

Null-Cloud-Datensouveränität

Alles bleibt auf dem Gerät. Verarbeiten Sie vertrauliche Schriftsätze, proprietären Code oder persönliche Aufzeichnungen mit der absoluten Gewissheit, dass Ihre Daten niemals zum Training verwendet oder auf einem entfernten Server gespeichert werden.

Native Metal 3-Optimierung

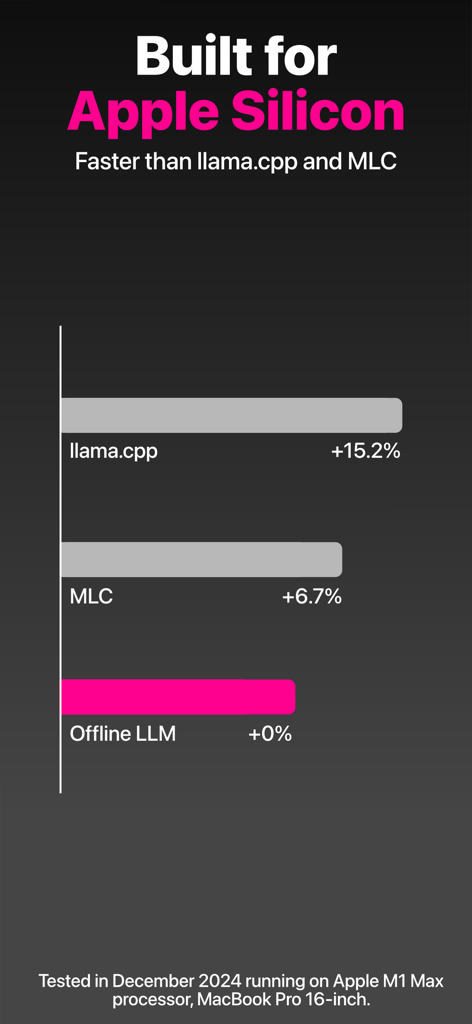

Entwickelt für maximalen Durchsatz auf M-Serie-Chips. Übertrifft Standardimplementierungen durch Nutzung einer benutzerdefinierten Ausführungs-Engine, die für flüssige Echtzeitantworten auf iPhone, iPad und Mac entwickelt wurde.

Ähnliche Apps

Top-gerankte Apps in derselben Kategorie

ChatGPT

OpenAI OpCo, LLC

Google Gemini

Google LLC

Grok

X.AI Corporation

Gmail - Email by Google

Google LLC

千问 - 阿里最强大模型官方AI助手

Shanghai Zhixin Puhui Technology Co., Ltd.

Google Drive

Google LLC

Microsoft Authenticator

Microsoft Corporation

Google Sheets

Google LLC

Google Docs

Google LLC

Diese Seite ist keine offizielle Seite der App oder ihres Entwicklers, sondern eine unabhängige redaktionelle Veröffentlichung, die zu Informations- und Kommentarzwecken erstellt wurde. Sofern nicht ausdrücklich anders angegeben, sind weder die App noch ihr Entwickler mit MWM, Apple, Google Play, dem App-Herausgeber oder dem Entwickler der App verbunden, von ihnen unterstützt, gesponsert, autorisiert oder anderweitig offiziell verbunden, und nichts auf dieser Seite impliziert, dass die App unter Verwendung der Dienste von MWM entwickelt wurde. Alle Marken, Logos, Screenshots und andere Inhalte bleiben Eigentum ihrer jeweiligen Inhaber.